Questo mese ha presentato Jeremy Howard, un ricercatore di intelligenza artificiale chatbot online Chiamata Chiacchierare alla figlia di 7 anni. È stato rilasciato pochi giorni fa da OpenAI, uno dei laboratori di intelligenza artificiale più ambiziosi al mondo.

Le disse di chiedere al chatbot sperimentale cosa avesse in mente. Ho chiesto perché è stata utilizzata la trigonometria, da dove vengono i buchi neri e perché i polli hanno incubato le loro uova. Ogni volta rispondeva in una prosa chiara e punteggiata. Quando ha chiesto un programma per computer in grado di prevedere la traiettoria di una palla lanciata in aria, le ha dato anche quello.

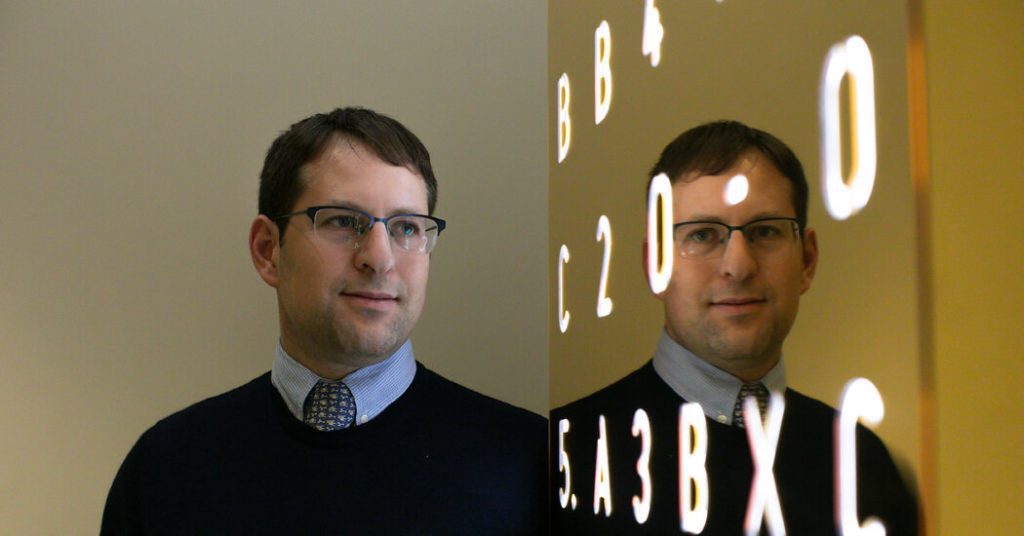

Nei prossimi giorni, il signor Howard, scienziato di dati e professore il cui lavoro ha ispirato la creazione di ChatGPT e tecnologie simili È venuto a vedere un chatbot come un nuovo tipo di tutor personale. Poteva insegnare a sua figlia matematica, scienze e inglese, per non parlare di altre importanti lezioni. Primo fra tutti: non credere a tutto ciò che ti viene detto.

“Mi dà un grande piacere vederla imparare in questo modo”, ha detto. “Ma le ho anche detto: non fidarti di tutto ciò che ti dà. Può andare storto”.

OpenAI è tra le tante aziende, laboratori accademici e ricercatori indipendenti che lavorano per costruire chatbot più avanzati. Tuttavia, questi sistemi non possono chattare come un essere umano Appaiono spesso. Possono anche recuperare e riassemblare informazioni a una velocità che gli esseri umani non potrebbero mai raggiungere. Possono essere visti come assistenti digitali, come Siri o Alexa, che sono più bravi a capire cosa stai cercando e a dartelo.

Dopo il rilascio di ChatGPT, che è stato utilizzato da più di un milione di persone, molti esperti ritengono che questi nuovi chatbot siano pronti a reinventare o addirittura a sostituire i motori di ricerca Internet come Google e Bing.

Possono presentare informazioni in frasi strette, piuttosto che in lunghi elenchi di collegamenti blu. Spiegano i concetti in modi che le persone possono capire. Possono presentare i fatti, mentre creano piani aziendali, argomenti cartacei e altre nuove idee da zero.

“Ora hai un computer in grado di rispondere a qualsiasi domanda in un modo che abbia senso per un essere umano”, ha affermato Aaron Levy, CEO di Silicon Valley, Box, e uno dei numerosi dirigenti che esplorano i modi in cui questi chatbot cambieranno. panorama tecnologico. “Può suscitare e prendere idee da contesti diversi e combinarle insieme”.

I nuovi chatbot lo fanno con quella che sembra una totale sicurezza. Ma non sempre dicono la verità. A volte falliscono anche semplici operazioni aritmetiche. Mescolano realtà e finzione. E mentre continua a migliorare, le persone possono usarlo Genera e diffondi bugie.

L’ascesa di OpenAI

L’azienda di San Francisco è uno dei laboratori di intelligenza artificiale più ambiziosi al mondo. Ecco uno sguardo ad alcuni dei recenti sviluppi.

Google ha recentemente creato un sistema proprietario per la conversazione, chiamato LaMDA, o Language Model for Dialog Applications. Questa primavera, un ingegnere di Google Ha affermato di essere cosciente. non è statoMa ha catturato l’immaginazione del pubblico.

Aaron Margolis, uno scienziato di dati ad Arlington, in Virginia, era tra il numero limitato di persone al di fuori di Google a cui era consentito utilizzare LaMDA tramite l’app sperimentale di Google, AI Test Kitchen. Era sempre stupito dal suo talento per la conversazione aperta. L’ho fatto divertire. Ma ha avvertito che potrebbe essere un mito, come ci si potrebbe aspettare da un sistema addestrato dalla grande quantità di informazioni pubblicate su Internet.

“Quello che ti dà è un po’ come un film di Aaron Sorkin”, ha detto. Il signor Sorkin ha scritto “The Social Network”, un film che viene spesso criticato per aver esteso la verità sull’origine di Facebook. “In parte sarà vero e in parte no.”

Di recente ha chiesto sia a LaMDA che a ChatGPT di parlargli come se fosse Mark Twain. Quando gli è stato chiesto da LaMDA, ha rapidamente descritto l’incontro tra Twain e Levi Strauss e ha detto che lo scrittore ha lavorato con il magnate dei blue jeans mentre viveva a San Francisco a metà del 1800. Sembrava giusto. Ma non lo era. Twain e Strauss hanno vissuto a San Francisco nello stesso periodo, ma non hanno mai lavorato insieme.

Gli scienziati chiamano questo problema “allucinazioni”. Proprio come un buon narratore, i chatbot hanno un modo per prendere ciò che hanno imparato e rimodellarlo in qualcosa di nuovo, senza preoccuparsi se sia vero o meno.

LaMDA è ciò che i ricercatori di intelligenza artificiale chiamano a rete neurale, un sistema matematico vagamente modellato sulla rete di neuroni del cervello. Questa è la stessa tecnologia che Traduce dal francese all’inglese Su servizi come Google Translate identifica i pedoni come Le auto a guida autonoma percorrono le strade della città.

Una rete neurale apprende le competenze analizzando i dati. Identificando modelli in migliaia di immagini di gatti, ad esempio, può imparare a identificare un gatto.

Cinque anni fa, i ricercatori di Google e laboratori come OpenAI hanno iniziato a progettare reti neurali che Analizza enormi quantità di testo digitale, inclusi libri, articoli di Wikipedia, notizie e registri di chat online. Gli scienziati li chiamano “paradigmi linguistici di grandi dimensioni”. Identificando miliardi di schemi distinti nel modo in cui le persone associano parole, numeri e simboli, questi sistemi hanno imparato a creare testo da soli.

La loro capacità di generare il linguaggio ha sorpreso molti ricercatori del settore, compresi molti dei ricercatori che l’hanno costruito. La tecnologia può imitare ciò che le persone hanno scritto e combinare concetti disparati. Potresti chiedergli di scrivere una scena di “Seinfeld” in cui Jerry impara una tecnica matematica esoterica chiamata algoritmo di ordinamento delle bolle – e voluto.

Con ChatGPT, OpenAI ha migliorato la tecnologia. Non fa una chat a flusso libero come LaMDA di Google. Progettato per funzionare più come Siri, Alexa e altri assistenti digitali. Come LaMDA, ChatGPT si è formato su un mare di testi digitali estratti da Internet.

Quando le persone hanno testato il sistema, è stato chiesto loro di valutare le sue risposte. Sono stati convincenti? È stato utile? Erano onesti? Poi attraverso una tecnologia chiamata Rinforzo dell’apprendimentoHo usato le valutazioni per mettere a punto il sistema e definire più attentamente cosa avrebbe fatto e cosa non avrebbe fatto.

“Questo ci consente di arrivare al punto in cui il modello può interagire con te e ammettere quando è sbagliato”, ha affermato Mira Moratti, Chief Technology Officer di OpenAI. “Può rifiutare qualcosa che è inappropriato e può contestare una domanda o un’ipotesi che non è valida.”

Il metodo non era perfetto. OpenAI ha avvertito coloro che utilizzano ChatGPT che “può occasionalmente generare informazioni errate” e “produrre istruzioni dannose o contenuti di parte”. Ma l’azienda prevede di continuare a migliorare la tecnologia e ricorda alle persone che la utilizzano che si tratta ancora di un progetto di ricerca.

Anche Google, Meta e altre società risolvono problemi di precisione. recentemente morto Rimozione Anteprima online del suo chatbot, Galactica, perché genera spesso informazioni errate e distorte.

Gli esperti hanno avvertito che le aziende non controllano il destino di queste tecnologie. Sistemi come ChatGPT, LaMDA e Galactica si basano su idee, documenti di ricerca e codici informatici che circolano liberamente da anni.

Aziende come Google e OpenAI possono far progredire la tecnologia a un ritmo più veloce di altre. Ma la loro ultima tecnologia è stata ampiamente riprodotta e distribuita. Non possono impedire alle persone di utilizzare questi sistemi per diffondere disinformazione.

Proprio come il signor Howard sperava che sua figlia imparasse a non fidarsi di tutto ciò che leggeva su Internet, sperava che la società imparasse la stessa lezione.

“Puoi programmare milioni di questi robot in modo che sembrino umani e avere conversazioni progettate per convincere le persone di un certo punto di vista”, ha affermato. L’avevo avvertito anni fa. Ora è chiaro che questo è in attesa di accadere”.

“Giocatore. Aspirante evangelista della birra. Professionista della cultura pop. Amante dei viaggi. Sostenitore dei social media.”

More Stories

Steward Healthcare chiude due ospedali nel Massachusetts – Boston 25 News

Tesla, Alphabet, NVIDIA, AT&T, Visa, Texas Instruments, Enface e altre società

Azioni Google: i profitti e i ricavi di Google superano la forte pubblicità sui motori di ricerca e la crescita del cloud